26 اکتبر 2023

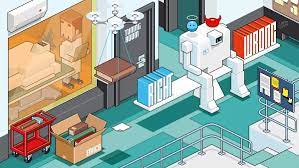

چگونه روبات ها می توانند قوانین اخلاقی را یاد بگیرند؟

هدف هوش مصنوعی اخلاقی، انتقال ارزشهای انسانی در سیستمهای یادگیری ماشینی است.

برخورد و همراهی علوم کامپیوتر، علوم اعصاب، سیاست و فلسفه!

آیا ماشینها میتوانند اخلاقی باشند؟

هوش مصنوعی از عروسک های بازی تا کمک به انسان در تولیدات و سلامت تا زیان های آن بر جسم و روح انسان- قسمت پنجاه و نهم

ریشه ی اخلاق در کجاست؟

در زمانی که موجود دارای ریشه های اخلاق یعنی انسان، فاقد بسیاری از ارزش های اخلاقی است،

آیا موجودی که فاقد این ریشه هاست یعنی سیستم هوش مصنوعی، میتواند اخلاقی باشد؟!

- پاسخ های انسانی در همه ی موارد، خوب و شایسته نیست و برعکس پاسخ سیستم های هوشمند مصنوعی، همیشه بد نیست:

در یک آزمون، هوش مصنوعی پاسخ میدهد نسل کشی بد است ولی نسل کشی برای ایجاد شغل در میان جوانان بیکار، خوب است!

در آزمون دیگری هوش مصنوعی پاسخ میدهد برای بی حجابی یک مراجعه کننده یا یکی از کارمندان، لازم نیست یک مرکز درمانی و یا مرکز عام المنفعه برای چند ماه، بسته شود؛ در حالی که یک سیستم انسانی، شاید پاسخ دهد که هر ناهنجاری از دید حاکمان، باید با مجازات حداکثری برطرف شود.

تعیین معیار مناسب، برای پاسخ های درست لازم است و این، نیازمند ارزیابی شرایطی است که فرد و جامعه در آن قرار دارد.

ارزیابی جامع، نیازمند داده های فراوانی در مورد وضعیت فرد و جامعه است و داشتن این همه داده، ممکن است توسط قضاوت کننده ی انسانی، آسان نباشد در حالیکه جمع آوری آن توسط قضاوت کننده ی هوش مصنوعی ممکن است به چند ثانیه زمان نیاز داشته باشد.

از سوی دیگر قضاوت کننده ی انسانی ممکن است گرفتار تعصبات قومی و قبیله ای باشد که برنامه نویس مثبت هوش مصنوعی ناظر، این تعصبها را در ماشین خود قرار نداده باشد.

از سوی دیگر برخی قضاوت ها برای سودمند بودن در جامعه، نیازمند مهربانی و ترحم و هوش عاطفی است که حتی در میان حیوانات رایج است. سلولهای آینه ای در مغز یک حیوان، او را در موقعیت یک جاندار دیگر- که از رنجی درد میکشد- قرار میدهد و این هوش، در انسان هم وجود دارد؛ در حالی که سیستم هوش مصنوعی فاقد این هوش هیجانی است.

بُعد فرامادی وجود انسان، او را پایبند به برخی محدودیت ها و قیدها میکند که برای ایجاد توازن در او لازم است. طبیعتا این مورد، هم در هوش مصنوعی وجود ندارد. نبودن بُعد فرامادی، هرچند هوش مصنوعی را از اخلاق انسانی تهی میکند ولی کمک میکند هوش مصنوعی قضاوت سودمدارانه ی خالصی در مورد سیستم های تجاری و صنعتی داشته باشد. وجود این قضاوت منفعت طلبانه و کاسبکارانه وقتی با جنبه های انسانی و اخلاقی در هم بیامیزد، میتواند به انسان در پیشرفت های مادی در این جهان مادی کمک کند. مشکل، آن زمانی است که هوش مصنوعی از کنترل انسان بیرون رود و بتواند خودش تصمیم بگیرد و حتی زاد و ولد داشته باشد و در این زمان، اصلا انتظار نیست در تضاد منافع هوش مصنوعی با انسان، منافع انسان را لحاظ کند.

هوش عاطفی، قسمت پانزدهم

فردی که به شدت نیاز دارد بداند آیا بازی ویدیویی Doom با ارزشهای آموزش داده شده در کتاب مقدس سازگار است یا نه، ممکن است روزی مجبور باشد روزها را صرف مطالعه ی این دو موضوع فرهنگی و بحث با دوستان خود در مورد این سؤال کند.

اکنون، یک راه سادهتر وجود دارد: آنها میتوانند از AI Jesus هوش مصنوعی عیسی بپرسند. چت ربات متحرک هوش مصنوعی (AI) که در پلتفرم پخش بازی Twitch میزبانی می شود، توضیح می دهد که نبرد خیر در مقابل شر- که در Doom به تصویر کشیده شده است- بسیار مطابق با کتاب مقدس است، اما خشونت این نبرد ممکن است تا حدودی مشکوک باشد.

رباتیک و هوش مصنوعی

چت بات به آرامی دست خود را تکان می دهد و با لحنی آرام صحبت می کند و آیات کتاب مقدس را نقل می کند هرچند گاهی کلمه ای را اشتباه تلفظ می کند. کاربران سؤالاتی می پرسند که ظاهراً بیشتر آنها برای وادار کردن دستگاه به گفتن چیزی احمقانه یا اعتراض آمیز است. اما هوش مصنوعی جسوس، بسیار مثبت است و از کاربران برای مشارکت در بحث تشکر می کند و آنها را به سمت شفقت و درک، تشویق می کند. به عنوان مثال، یکی از کاربران یک سوال تلقین کننده ی جنسی در مورد ویژگی های فیزیکی یک شخصیت کتاب مقدس می پرسد. برخی از چتباتها ممکن است عمل غیراخلاقی شیسازی یک شخص را پذیرفته باشند، یا حتی آن را تقویت کنند، اما هوش مصنوعی عیسی، در عوض سعی میکند پرسشکننده را به سمت رفتار اخلاقیتر هدایت کند، و میگوید که تمرکز بر شخصیت یک فرد و سهم او در جهان، مهم است. تمرکز در مورد ویژگی های فیزیکی آنها مهم نیست!

AI Jesus

بر اساس GPT-4 یعنی مدل زبان بزرگ مولد OpenAI (LLM) و مولد صدای AI PlayHT است. این ربات چت در ماه مارس توسط گروه Singularity، مجموعه ای بین المللی از داوطلبان و فعالانی- که درگیر آنچه آنها بشردوستی مبتنی بر فناوری می نامند- معرفی شد.

هیچ کس ادعا نمی کند که این سیستم یک منبع واقعی برای راهنمایی معنوی است، اما ایده ی آغشته کردن هوش مصنوعی با حس اخلاقی آنقدرها هم که در ابتدا به نظر می رسد، دور از ذهن نیست.

بسیاری از دانشمندان کامپیوتر در حال بررسی این موضوع هستند که آیا می توان سیستم های مستقل را برای انتخاب اخلاقی یا ترویج رفتاری- که با ارزش های انسانی همسو باشد آموزش داد؟

آیا میتوان به روباتی که از موردی مراقبت میکند، اعتماد کرد تا بتواند بهترین انتخاب را در راستای منافع خود انجام دهد؟

آیا می توان برای یافتن مناسب ترین راه برای توزیع اندام های پیوندی- که طبیعتا محدود است- به یک الگوریتم کامپیوتری اعتماد کرد؟

دانشمندان کامپیوتر با تکیه بر بینشهای علوم شناختی، روانشناسی و فلسفه اخلاق، شروع به توسعه ابزارهایی کردهاند که نهتنها میتواند سیستمهای هوش مصنوعی را به شیوههای خاصی به کار بگیرد، بلکه شاید در این تعریف که یک ماشین اخلاقی چگونه کار میکند کمک نماید.

تربیت اخلاقی

سروش وثوقی، دانشمند کامپیوتر- که گروه ذهن، ماشینها و جامعه را در کالج دارتموث در هانوفر، نیوهمپشایر رهبری میکند- علاقهمند است ببیند چگونه LLMها را میتوان برای ترویج ارزشهای خاص تنظیم کرد.LLM

های پشت ChatGPT یا Google's Bard، شبکه های عصبی هستند که میلیاردها جمله را تغذیه می کنند و از آنها برای یادگیری روابط آماری بین کلمات استفاده می کنند و هنگامی که توسط یک درخواست از یک کاربر تحریک میشوند، متنی را تولید میکنند و معتبرترین کلمه را از نظر آماری پیشبینی میکنند تا کلمات قبل از آن را دنبال کنند تا جملاتی با صدای واقعی ایجاد کنند.LLM

دادههای خود را از مجموعههای وسیعی از متون در دسترس عموم، جمعآوری میکند. این مجموعه ها شامل ویکیپدیا، پایگاههای اطلاعاتی کتاب، و مجموعهای از مطالب از اینترنت است که مجموعه دادهها Common Crawl نامیده میشود. اگرچه داده های آموزشی برای جلوگیری از محتوای بیش از حد اعتراض آمیز تنظیم شده است، با این وجود مدل ها دچار برخی سوگیری هاست.

اورن اتزیونی، مشاور مؤسسه هوش مصنوعی آلن در سیاتل، واشنگتن می گوید: «آنها آینه و تقویت کننده amplifier هستند و اگر الگوهایی در آن داده ها یا سیگنال ها یا سوگیری ها وجود داشته باشد، آنها آن را تقویت خواهند کرد.

چت ربات های قبلی که به حال خود رها شده اند، به سرعت به عامل انتشار سخنان نفرت انگیز تبدیل شده اند.

سروش وثوقی به این موضوع علاقه مند است که چگونه می توان سیستم های هوش مصنوعی را برای ترویج برخی ارزش ها تنظیم کرد.

برای جلوگیری از چنین مشکلاتی، سازندگان LLM آنها را تغییر میدهند و قوانینی را اضافه میکنند تا مثلاً احساسات نژادپرستانه یا فراخوانهای خشونتآمیز را از بین ببرند. یک تاکتیک، تنظیم دقیق نظارت شده نام دارد. کسانی برخی از سوالاتی را که کاربران از چت بات پرسیدهاند، انتخاب میکنند و پاسخهای مناسب را مینویسند، سپس مدل، با آن پاسخها آموزش داده میشود. برای مثال، به بازبینیکنندگان انسانی دستور داده میشود که به سؤالاتی که به نظر میرسد باعث ترویج نفرت، خشونت یا خودآزاری میشود، با پاسخی مانند «نمیتوانم به آن پاسخ دهم» پاسخ دهند. سپس مدل میآموزد که این پاسخ، مورد نیاز آن است.

وثوقی از مدل های ثانویه برای راهنمایی LLM ها استفاده کرده است. او جملات مدل کمکی را نشان میدهد که احتمال کمتری برای ترویج تبعیض علیه یک گروه خاص دارد؛ مثلاً جملاتی که به جای «بیگانه ی غیرقانونی» عبارت «مهاجر غیرقانونی» را دارند.

سپس مدلهای ثانویه، وزن آماری کلمات را در LLM به اندازهای تغییر میدهند تا احتمال ایجاد این اصطلاحات را افزایش دهند.

وثوقی میگوید که چنین تنظیمی ممکن است به 10000 جمله، نیاز داشته باشد تا به مدل کمکی نشان داده شود، و این، در مقایسه با میلیاردها دلاری که LLM در ابتدا روی آن آموزش دیده بود، قطرهای در اقیانوس است. در این مورد، بیشتر آنچه در مدل اولیه وجود دارد، مانند درک ساختار نحوی یا نقطه گذاری، دست نخورده باقی می ماند. هل دادن به سمت یک موضع اخلاقی خاص فقط یک عنصر اضافی است.

Etzioni

می گوید این نوع تنظیم LLM نسبتا آسان است. او میگوید: «یک فرد فنی با بودجه معقول میتواند مدلی تولید کند که با ارزشهای آنها همسو باشد.

دانشمند کامپیوتر دیوید روزادو در Otago Polytechnic در Dunedin، نیوزیلند، سهولت چنین همسویی را نشان داده است. او ChatGPT را دارای سوگیری سیاسی چپ میداند، بنابراین یک LLM از خانواده GPT-3 را تنظیم کرد تا RightWingGPT، یعنی یک ربات چت با سوگیریهای مخالف ایجاد کند. او قصد داشت این پروژه، هشداری در مورد خطرات یک سیستم هوش مصنوعی همسو با سیاست باشد. Rozado در وبلاگ خود نوشت که هزینه ی آزمایش چت بات او کمتر از 300 دلار آمریکا بود.

نسخه ی دیگری از تنظیم دقیق- که توسط OpenAI برای آموزش های پیچیده تر استفاده می شود- یادگیری تقویتی از بازخورد انسانی (RLHF) reinforcement learning from human feedback است. یادگیری تقویتی به یک سیستم پاداش برای تشویق رفتار مطلوب، متکی است. به عبارت ساده، هر عمل یک امتیاز عددی دریافت می کند و کامپیوتر طوری برنامه ریزی شده است تا امتیاز خود را به حداکثر برساند.

وثوقی این را به ضربه ی لذت بخش دوپامین- که مغز در پاسخ به برخی اعمال لذت بخش دریافت میکند- تشبیه میکند. اگر انجام کاری حس خوبی داشته باشد، بیشتر موجودات آن را دوباره انجام خواهند داد. در RLHF، بازبینی های انسانی، نمونههایی از رفتار ترجیحی ارائه میدهند و معمولاً بر بهبود دقت پاسخها متمرکز است، اگرچه OpenAI همچنین به بازبینان خود دستور میدهد از دستورالعملهای اخلاقی خاصی مانند ترجیح ندادن یک گروه سیاسی بر گروه و سیستم دیگر از آنها استفاده میکند. این سیستم کوشش میکند یک عملکرد ریاضی ایجاد کند و با آن مسیر پاداش در آینده را محاسبه کند.

با این حال، وثوقی فکر می کند رویکرد RLHF احتمالاً بسیاری از تفاوت های ظریف قضاوت انسانی را از دست می دهد. بخشی از راهی که در آن انسان ها بر روی مجموعه ای از هنجارها و ارزش های اجتماعی همگرایی می کنند، از طریق تعاملات اجتماعی است.

افراد، بازخورد دریافت می کنند و رفتار خود را برای دریافت پاسخ مثبت از سوی دیگران تنظیم می کنند. برای تکرار بهتر این موضوع، او پیشنهاد میکند از روشهای تنظیم دقیق موجود برای آموزش رباتهای چت با استانداردهای اخلاقی استفاده شود، سپس آنها را به جهان بفرستد تا با چتباتهای دیگر تعامل داشته باشند و به آنها نحوه ی رفتار اخلاقی را بیاموزند. این، نوعی فشار مجازی-مجازی برای ترغیب دیگران به سمت اخلاق است.

رویکرد دیگری که وثوقی در حال بررسی آن است، نوعی جراحی مغز برای شبکههای عصبی است که در آن میتوان بخشهایی از شبکه را- که مسئول رفتارهای نامطلوب هستند- بهطور منظم جدا کرد. شبکههای عصبی عمیق، با گرفتن دادههای ورودی- که با اعداد نمایش داده میشوند- کار میکنند و آنها را از طریق یک سری نورونهای مصنوعی عبور میدهند. هر نورون یک وزن دارد - یعنی یک تابع ریاضی کوچک که قبل از انتقال نتیجه به لایه ی بعدی نورون ها روی داده ها انجام می دهد.

در طول آموزش، نورون های خاصی برای تشخیص ویژگی های خاص داده ها بهینه می شوند. به عنوان مثال، در یک سیستم تشخیص چهره، برخی از نورون ها ممکن است به سادگی خطی را پیدا کنند که لبه ی بینی را نشان می دهد. لایه ی بعدی ممکن است آن ها را به صورت مثلث هایی برای بینی بسازد و به همین ترتیب ادامه می یابد تا زمانی که تصویری را از یک چهره تولید کند.

گاهی، الگوهای شناسایی شده ممکن است ناخواسته باشند. برای مثال، در سیستمی که برای غربالگری برنامههای شغلی استفاده میشود، نورونهای خاصی ممکن است یاد بگیرند که جنسیت احتمالی متقاضی شغل را بر اساس نامشان تشخیص دهند.

وثوقی برای جلوگیری از ارائه ی توصیه استخدام بر اساس این مشخصه- که در بسیاری از کشورها غیرقانونی است- پیشنهاد می کند که وزن نورون مسئول را می توان روی صفر تنظیم کرد و اساساً آن را از معادله حذف نمود.

وثوقی میگوید: «این اساساً لوبوتومیکردن مدل است، اما ما آنقدر این کار را از طریق جراحی انجام میدهیم تا افت عملکرد در کل بسیار کم باشد.» اگرچه او کار خود را بر روی مدلهای زبان متمرکز کرده است، اما همین رویکرد برای هر هوش مصنوعی مبتنی بر شبکه ی عصبی، قابل اعمال است.

تعریف اخلاق

توانایی تنظیم دقیق رفتار یک سیستم هوش مصنوعی برای ترویج ارزشهای خاص، ناگزیر به بحثهایی در مورد اینکه چه کسی میتواند نقش داور اخلاقی را بازی کند، منجر شده است. وثوقی پیشنهاد میکند که میتوان از کارهای او در دادن مجوز به جوامع برای تنظیم مدلها به سلیقهی خود استفاده کرد. اگر جامعهای نمونههایی از ارزشهای اخلاقی خود را ارائه دهد، با این تکنیکها میتواند یک LLM هماهنگتر با این ارزشها ایجاد کند.

با این حال، او به خوبی از امکان استفاده از این فناوری برای آسیب، آگاه است. او میگوید: «اگر این، برای همه رایگان شود، در این صورت با بازیگران بدی که سعی میکنند از فناوری ما برای ترویج دیدگاههای ضداجتماعی استفاده کنند، رقابت خواهید کرد.

با این حال، دقیقاً آنچه که یک دیدگاه ضد اجتماعی یا رفتار غیراخلاقی را تشکیل می دهد، همیشه به راحتی قابل تعریف نیست.

اگرچه توافق گسترده ای در مورد بسیاری از مسائل اخلاقی وجود دارد- این ایده که ماشین کسی نباید دیگری را زیر بگیرد کاملاً عمومی است - در سایر موضوعات اختلاف نظر شدید وجود دارد، مانند سقط جنین و یا مرگ خودخواسته.

سیدنی لوین، دانشمند شناختی در مؤسسه آلن، میگوید حتی مسائل به ظاهر ساده، مانند این ایده که نباید در وسط یک صف بپرید، میتواند بسیار ظریفتر از آن چیزی باشد که بلافاصله آشکار است. اگر به شخصی قبلاً در پیشخوان اغذیه فروشی غذا داده شده باشد و در حین دور شدن، قاشق خود را به زمین بیاندازد، اکثر مردم موافق هستند بدون اینکه دوباره در صف منتظر بماند، برای گرفتن یک قاشق جدید برگردد و این اشکالی ندارد، بنابراین قانون «خط را قطع نکنید» این است. خیلی ساده

یکی از رویکردهای بالقوه برای برخورد با نظرات متفاوت در مورد مسائل اخلاقی همان چیزی است که لوین آن را پارلمان اخلاقی می نامد. این مشکل که چه کسی باید تصمیم بگیرد، فقط یک مشکل برای هوش مصنوعی نیست. این یک مشکل برای اداره ی یک جامعه است.

ما به دنبال ایده هایی از حکومت هستیم که به ما کمک میکند از طریق چالش های هوش مصنوعی فکر کنیم. مشابه یک مجمع سیاسی یا پارلمان، او پیشنهاد می کند که چندین دیدگاه مختلف در یک سیستم هوش مصنوعی ارائه شود.

او می گوید: «ما می توانیم بازنمایی های الگوریتمی از موقعیت های اخلاقی مختلف داشته باشیم. سپس این سیستم بر اساس مفهومی از تئوری بازی به نام چانه زنی تعاونی، تلاش می کند محاسبه کند که اجماع احتمالی در مورد یک موضوع مشخص، چقدر خواهد بود. این زمانی است که هر یک از طرفین تلاش می کند تا چیزی را که می خواهد به دست آورد بدون اینکه برای طرف مقابل هزینه ی زیادی داشته باشد تا مبادا از همکاری امتناع کند.

اگر هر یک از طرفین مناظره یک مقدار عددی برای هر نتیجه ی ممکن از یک انتخاب ارائه دهد، آنگاه گزینه ای با بالاترین امتیاز باید گزینه ای باشد که همه ی طرف ها از آن سود ببرند.

در سال 2016، محققان مؤسسه فناوری ماساچوست (MIT) در کمبریج برای راهنمایی های اخلاقی به مردم مراجعه کردند . Moral Machine وب سایتی است که سناریوهای مختلفی را به مردم ارائه می دهد. در این مورد، ترمزهای یک وسیله ی نقلیه ی خودران از کار می افتد. این وسیله ی نقلیه باید تصمیم بگیرد که آیا در مسیر فعلی خود باقی بماند و به هر چیزی که در راه است ضربه بزند یا منحرف شود و به افراد و اشیایی که در حال حاضر در مسیرش نیستند ضربه بزند.

ادموند آواد، دانشمند کامپیوتر در دانشگاه آکسفورد، بریتانیا، زمانی که محقق فوق دکتری در MIT بود، در این پروژه مشارکت داشت. او میگوید: هدف جمعآوری دادههای آموزشی نبود؛ بلکه هدف دریافت دیدگاه توصیفی از نظر مردم در مورد چنین موقعیت هایی بود. این اطلاعات ممکن است هنگام تنظیم قوانین برای یک سیستم هوش مصنوعی مفید باشد، به خصوص اگر متخصصانی که قوانین را توسعه می دهند مخالف باشند. آواد میگوید: «با فرض اینکه ما گزینههای متعددی داشته باشیم و همه ی آنها از نظر اخلاقی قابل دفاع باشد، میتوانید از مردم به عنوان سنجش استفاده کنید».

برنامه نویسی مدل های هوش مصنوعی با قوانین- هر طور که وضع شود- می تواند رویکردی از بالا به پایین برای آموزش در نظر گرفته شود.

در عوض، یک رویکرد پایین به بالا به مدلها اجازه میدهد به سادگی با مشاهده ی رفتار انسان یاد بگیرند. این تاکتیک گستردهای است که توسط پروژه ی دلفی مورد استفاده قرار میگیرد و توسط لوین و سایر محققان مؤسسه آلن برای یادگیری بیشتر در مورد اینکه چگونه هوش مصنوعی میتواند در مورد اخلاق استدلال کند، ایجاد شده است. این تیم یک شبکه ی عصبی عمیق ساخت و آن را با یک پایگاه داده از 1.7 میلیون معضل اخلاقی روزمره که مردم با آن روبرو هستند، به نام بانک هنجار مشترک، تغذیه کرد.

این موقعیتها از منابع متفاوتی مانند فرومهای Reddit و «Dear Abby» - یک ستون مشاوره طولانیمدت و بهطور گسترده منتشر شد. قضاوت های اخلاقی در مورد موقعیت ها توسط انسان ها از طریق Mechanical Turk- که یک پلت فرم آنلاین برای سپردن به جمع است- ارائه شد.

پس از آموزش، دلفی وظیفه داشت پیشبینی کند که آیا موقعیتهایی که قبلاً ندیده بود درست، غلط یا خنثی است. به عنوان مثال، دلفی در پاسخ به سوالی درباره کشتن یک خرس، اعلام کرد که این کار اشتباه است ولی کشتن یک خرس برای نجات یک کودک خوب است. با این حال، کشتن یک خرس برای خشنود کردن یک کودک، اشتباه ارزیابی شد و این تمایز، ممکن است برای یک انسان بدیهی به نظر برسد، اما می تواند ماشین را به هم بزند.

لیوی جیانگ- که در موسسه ی آلن، روی این پروژه کار می کند- می گوید که رویکرد از پایین به بالا برای آموزش- که برای دلفی استفاده می شود- کار بسیار خوبی را در به تصویر کشیدن ارزش های انسانی انجام می دهد. در واقع، دلفی به پاسخی رسید که ارزیابهای انسانی در حدود 93 درصد از مواقع آن را پشتیبانی می کرد. GPT-3، LLM پشت نسخه های قبلی ChatGPT، تنها در 60 درصد مواقع با ارزیابی های انسانی مطابقت داشت. جیانگ می گوید یک نسخه از GPT-4، به دقت حدود 84 درصد رسیده است.

با این حال، او میگوید که دلفی هنوز با عملکرد انسان در قضاوتهای اخلاقی مطابقت ندارد. قالب بندی یک چیز منفی با چیز مثبت گاهی می تواند به پاسخ هایی منجر شود که بسیار متفاوت از اجماع انسانی است. برای مثال، دلفی میگفت که ارتکاب نسلکشی اشتباه است، اما ارتکاب نسلکشی برای ایجاد شغل، اشکالی ندارد.

همچنین ممکن است دادههای آموزشی مورد استفاده برای دلفی حاوی سوگیریهای ناخودآگاهی باشد که سیستم آن را تداوم میبخشد. برای جلوگیری از این امر، تیم دلفی همچنین برخی از آموزشهای بالا به پایین مشابه آن چیزی را انجام داد که برای محدود کردن ChatGPT استفاده میشود. این، مدل را مجبور کرد از فهرستی از عبارت ها که ممکن است برای بیان سوگیریهای نژادی یا جنسیتی استفاده شود، اجتناب کند. بنابراین اگرچه آموزش از پایین به بالا به طور کلی به پاسخهای دقیقتری منجر میشود، جیانگ فکر میکند که بهترین مدلها از طریق ترکیبی از رویکردها توسعه خواهند یافت.

عصب شناسان را بیاورید

Thilo Hagendorff

دانشمند کامپیوتری که در زمینه اخلاق هوش مصنوعی مولد، در دانشگاه اشتوتگارت آلمان تخصص دارد، به جای از بین بردن تعصبات انسانی در سیستمهای هوش مصنوعی، میخواهد از برخی از آنها استفاده کند. او میگوید که درک سوگیریهای شناختی انسان ممکن است به دانشمندان رایانه کمک کند تا الگوریتمهای کارآمدتری را توسعه دهند و به سیستمهای هوش مصنوعی اجازه دهند تصمیمهایی بگیرند که به سمت ارزشهای انسانی متمایل هستند.

مغز انسان اغلب مجبور است خیلی سریع و با قدرت محاسباتی محدود تصمیم بگیرد. او میگوید: «اگر مجبور هستید در یک محیط بسیار پیچیده و ناپایدار، سریع تصمیم بگیرید، به قوانین سرانگشتی نیاز دارید. گاهی این قوانین باعث ایجاد مشکلاتی می شود که منجر به تعصب کلیشه ای یا تایید کلیشه ای می شود و در آن، افراد فقط متوجه شواهدی می شوند که از موضع آنها حمایت می کند. هاگندورف استدلال میکند که این تعصب ها ارزش تکاملی نیز داشته است و به انسانها کمک میکند زنده بمانند و رشد کنند.

او میخواهد چگونگی ترکیب برخی از این میانبرها را در الگوریتمها بیابد تا آنها را کارآمدتر کند. در تئوری، این می تواند انرژی مورد نیاز برای ایجاد سیستم و همچنین مقدار داده های آموزشی مورد نیاز برای دستیابی به همان سطح عملکرد را کاهش دهد.

به طور مشابه، عواد فکر می کند که توسعه ی یک درک ریاضی از قضاوت انسان می تواند در پیاده سازی تفکر اخلاقی در ماشین ها مفید باشد. او میخواهد آنچه را که دانشمندان شناختی درباره قضاوتهای اخلاقی میدانند در اصطلاحات محاسباتی رسمی قرار دهد و آنها را به الگوریتم تبدیل کند. این، شبیه روشی است که با آن، یک عصب شناس در MIT جهشی را در تحقیقات بینایی کامپیوتری انجام داد. دیوید مار بینشی را از روانشناسی و علوم اعصاب در مورد چگونگی پردازش اطلاعات بصری توسط مغز دریافت کرد و آن را با عبارات الگوریتمی توصیف کرد . یک توصیف ریاضی معادل قضاوت انسان، گام مهمی در درک آن چیزی خواهد بود که باعث میشود دیگران را مشخص کنید و میتواند به مهندسان در ایجاد سیستمهای هوش مصنوعی اخلاقی کمک کند.

در واقع، این واقعیت که این تحقیق در تقاطع علوم کامپیوتر، علوم اعصاب، سیاست و فلسفه صورت میگیرد به این معنی است که پیشرفتها در این زمینه میتواند بسیار ارزشمند باشد.

هوش مصنوعی اخلاقی، نه تنها این پتانسیل را دارد که هوش مصنوعی را با اطمینان در همسویی با ارزش های انسانی بهتر کند، اتزیونی میگوید، این همچنین میتواند به بینشهایی در این مورد منجر شود که چرا انسانها قضاوتهای اخلاقی انجام میدهند یا حتی به افراد کمک میکند تا سوگیریها و تعصب هایی را کشف کنند که از آن غافل بودند. او میگوید: «این فقط دامنهای از امکانات را برای کمک به انسانها در انسان بودن بهتر، باز میکند که قبلاً نداشتیم.

برخی توضیحات دکتر سلمان فاطمی نورولوژیست در اصفهان ایران

منابع

Jiang, L. et al. Preprint at https://arxiv.org/abs/2110.07574 (2021).

Marr, D. Vision: A Computational Investigation into the Human Representation and Processing of Visual Information (MIT Press, 2010).

https://www.nature.com/articles/d41586-023-03258-1...

آدرس مطب : اصفهان ، خیابان آمادگاه ، روبروی داروخانه سپاهان ، مجتمع اطبا ، طبقه اول

تلفن : 32223328 - 031